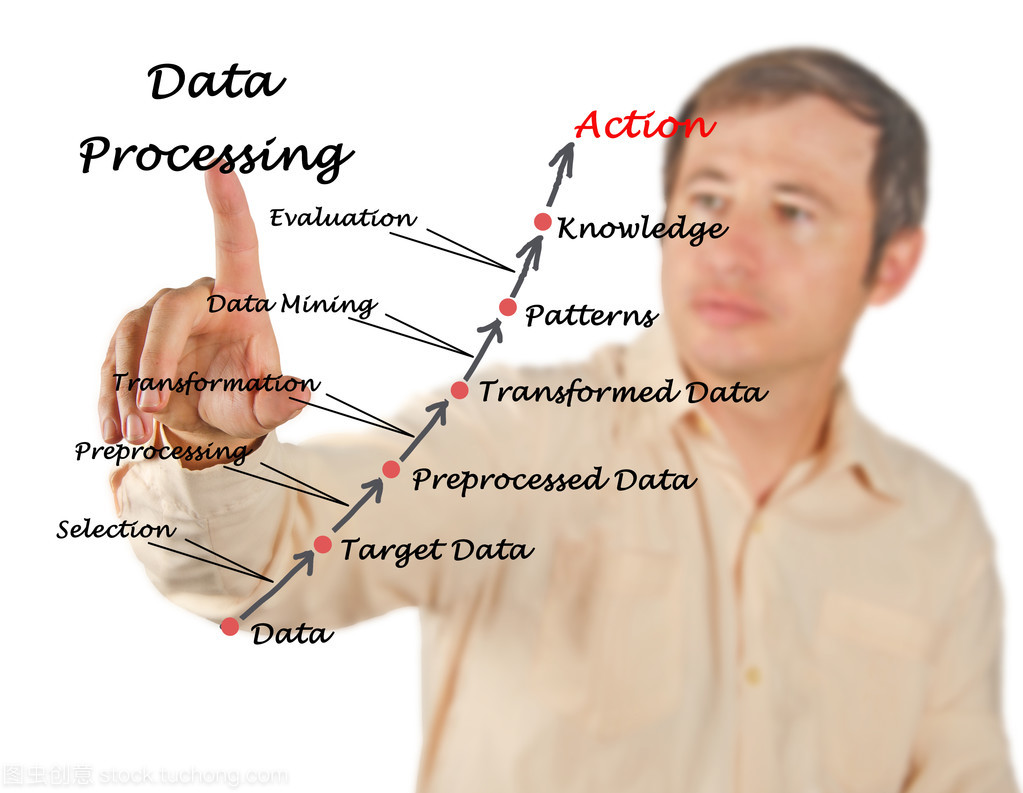

词云作为一种直观的数据可视化方式,能够通过词语大小、颜色和布局展示文本数据中的关键信息。要生成高质量的词云,数据预处理是不可或缺的关键环节。本文将从数据处理流程、核心方法和实践建议三个方面,系统介绍词云制作中的数据预处理技术。

一、数据预处理的核心流程

1. 数据收集与清洗

词云的数据来源通常包括网页内容、社交媒体文本、调查报告等。首先需要进行数据清洗,去除HTML标签、特殊符号、无关字符等噪声数据。对于中文文本,还需要处理全角/半角字符的统一转换。

2. 文本分词处理

英文文本可以通过空格进行自然分词,而中文文本则需要借助分词工具。常用的中文分词工具有jieba、HanLP等,它们能够准确识别词语边界,提高分词的准确性。分词过程中需要考虑新词发现和领域词典的补充。

3. 停用词过滤

停用词指那些在文本中出现频繁但缺乏实际意义的词语,如“的”、“了”、“和”等。建立停用词表并过滤这些词语,可以有效提升词云的可读性和信息密度。不同领域可能需要定制化的停用词表。

4. 词频统计与权重计算

在完成分词和过滤后,需要统计每个词语的出现频率。词频统计不仅要考虑绝对次数,还需要结合文档频率、逆文档频率等指标计算词语的重要性权重,确保词云能够准确反映文本的核心内容。

二、高级数据处理技术

1. 同义词合并

为避免词云中出现大量含义相近的词语,可以采用同义词库或词向量技术进行词语合并。例如将“电脑”、“计算机”、“微机”统一表示为“计算机”,提高词云的语义集中度。

2. 词性筛选

根据分析目的,可以保留特定词性的词语。例如在分析产品评论时,重点关注名词和形容词;在分析政策文件时,重点关注动词和名词。这种筛选能够使词云更具针对性。

3. 短语识别与处理

除了单个词语,还可以识别和处理固定短语。如“人工智能”、“机器学习”等专有名词应该作为一个整体出现,而不是被拆分成独立的词语。

三、实践建议与优化策略

1. 数据质量评估

在处理过程中要持续评估数据质量,包括文本完整性、噪声比例、分词准确性等指标。建立质量检查机制,确保预处理后的数据符合词云生成的要求。

2. 参数调优

根据文本特点和展示需求,调整停用词表、分词粒度、词频阈值等参数。建议通过多次试验找到最优的参数组合。

3. 可视化效果优化

数据预处理的结果直接影响词云的视觉效果。可以通过控制词语数量、设置合理的颜色方案、调整字体大小范围等方式,提升词云的美观度和信息传达效果。

词云的数据预处理是一个系统性的工程,需要综合考虑文本特点、分析目标和展示需求。通过科学的数据处理方法和持续优化,才能生成既美观又具有深度的词云可视化效果。在实际应用中,建议结合具体场景灵活调整处理策略,充分发挥词云在数据洞察和价值发现中的作用。